引言:步入AI世界

隨著人工智能技術的迅猛發展,機器學習與深度學習已成為驅動創新的核心引擎。TensorFlow,作為Google開源的一款強大且靈活的機器學習框架,為開發者提供了構建和部署AI應用的基石。本系列文章旨在從零開始,引導讀者掌握使用TensorFlow進行實戰開發的關鍵步驟。作為開篇,我們將首先夯實基礎,深入探討人工智能的基本概念及其軟件開發的核心知識。

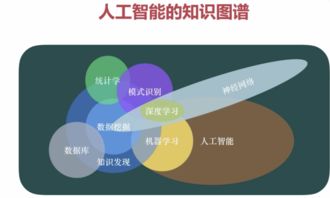

一、人工智能基礎知識精要

理解人工智能(AI)是開啟TensorFlow之旅的前提。人工智能是一個廣泛的領域,致力于創造能夠執行通常需要人類智能的任務的機器或軟件。其核心分支包括:

- 機器學習:AI的核心實現方式,使計算機能夠從數據中學習規律并進行預測,而無需進行明確的編程。它是大多數現代AI應用的基礎。

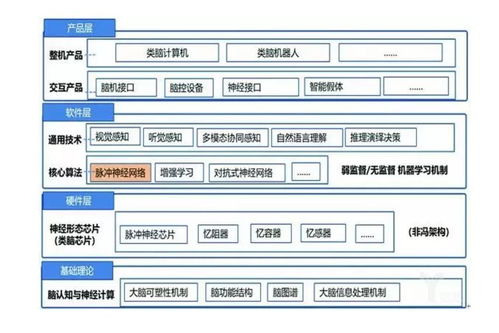

- 深度學習:機器學習的一個子集,它使用被稱為“神經網絡”的復雜結構模型,尤其擅長處理圖像、語音和文本等非結構化數據。TensorFlow正是深度學習領域的旗艦框架之一。

在深度學習中,神經網絡模仿人腦神經元的工作方式,通過多層處理(“深度”)來提取數據的多層次特征。理解諸如神經元、權重、偏置、激活函數(如ReLU、Sigmoid)、損失函數和優化器(如梯度下降) 等基本概念至關重要。

二、AI基礎軟件開發環境搭建

工欲善其事,必先利其器。在開始TensorFlow編程前,需要搭建合適的開發環境。

- 編程語言:Python 是AI開發的事實標準語言,因其簡潔的語法、豐富的科學計算庫(如NumPy、Pandas)和龐大的AI生態而廣受青睞。確保你已安裝Python(建議3.7及以上版本)。

- 開發工具:

- Jupyter Notebook / Jupyter Lab:非常適合進行交互式代碼編寫、數據可視化和教學,是學習和原型設計的絕佳選擇。

- PyCharm、VS Code 等集成開發環境(IDE),提供代碼補全、調試等高級功能,適合大型項目開發。

- 環境管理:強烈推薦使用 Anaconda 或 venv 創建獨立的Python虛擬環境。這可以避免不同項目間的庫版本沖突。

三、TensorFlow核心概念與安裝

TensorFlow使用“張量”(Tensor)作為基本數據結構。張量可以簡單理解為多維數組(標量是0維張量,向量是1維,矩陣是2維)。數據在操作之間以張量的形式流動(Flow),故名TensorFlow。

安裝TensorFlow 非常簡單。在配置好的Python環境中,通常只需一條pip命令:`bash

pip install tensorflow`

對于需要GPU加速的用戶(可大幅提升模型訓練速度),請確保系統已安裝CUDA和cuDNN,然后安裝tensorflow-gpu(在TF 2.x之后,通常統一為tensorflow包,會自動檢測GPU)。

安裝后,在Python中通過 import tensorflow as tf 即可導入并使用。

四、第一個TensorFlow程序:從線性回歸開始

讓我們通過一個經典的機器學習問題——線性回歸,來直觀感受TensorFlow的工作流程。線性回歸的目標是找到一條最佳擬合直線,描述輸入特征 X 和輸出目標 y 之間的線性關系。

`python

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

1. 準備數據

生成模擬數據:y = 2*x + 1 + 噪聲

X = np.linspace(-1, 1, 100)

y = 2 * X + 1 + np.random.normal(0, 0.1, 100)

2. 構建模型

定義可訓練參數(權重和偏置),初始值為隨機數

W = tf.Variable(tf.random.normal([1]))

b = tf.Variable(tf.zeros([1]))

3. 定義模型(前向傳播)

def linear_model(x):

return W * x + b

4. 定義損失函數(均方誤差)

def lossfn(ytrue, ypred):

return tf.reducemean(tf.square(ytrue - ypred))

5. 選擇優化器(隨機梯度下降)

optimizer = tf.optimizers.SGD(learning_rate=0.1)

6. 訓練模型

epochs = 100 # 訓練輪數

for epoch in range(epochs):

with tf.GradientTape() as tape: # 梯度帶,記錄計算過程以自動求導

ypred = linearmodel(X)

loss = lossfn(y, ypred)

# 計算梯度

gradients = tape.gradient(loss, [W, b])

# 根據梯度更新參數

optimizer.apply_gradients(zip(gradients, [W, b]))

if (epoch+1) % 20 == 0:

print(f'Epoch {epoch+1}, Loss: {loss.numpy():.4f}, W: {W.numpy()[0]:.4f}, b: {b.numpy()[0]:.4f}')

7. 結果可視化

plt.scatter(X, y, label='Original Data')

plt.plot(X, linear_model(X), color='red', label='Fitted Line')

plt.legend()

plt.show()`

代碼解析:

- 我們創建了變量 W 和 b,它們是模型要學習的參數。

- 使用 tf.GradientTape() 上下文管理器來自動計算損失函數關于參數的梯度。

- 優化器根據計算出的梯度更新參數,不斷降低損失值。

- W 和 b 的值應接近真實的 2 和 1。

五、與展望

本章我們梳理了人工智能與機器學習的核心概念,搭建了基礎的TensorFlow開發環境,并通過一個簡單的線性回歸實例,實踐了TensorFlow模型構建、訓練和評估的基本流程。關鍵在于理解定義模型、計算損失、計算梯度、更新參數這一循環迭代的訓練本質。

這僅僅是起點。在接下來的篇章中,我們將深入TensorFlow的高層API(如Keras),構建更復雜的神經網絡(如全連接網絡、卷積神經網絡CNN、循環神經網絡RNN),處理真實世界的數據集,并探討模型部署等進階主題。扎實的基礎是應對未來復雜挑戰的保障,請務必理解并親手運行本章的每一行代碼。

讓我們在TensorFlow的海洋中,繼續揚帆起航。